苹果终于也开源了 重磅发布OpenELM模型 搭载AI的iPhone就要来了

就在谷歌、三星和微软继续在个人电脑和移动设备上大力推广人工智能生成技术的同时,苹果也加入了这一行列,推出了OpenELM。

这是一个全新的开源大型语言模型(LLM)系列,可以完全在单个设备上运行,而无需连接云服务器。

01.模型特点与性能

当地时间周三,OpenELM在人工智能代码社区Hugging Face上发布,它由一系列小型模型组成,旨在高效执行文本生成任务。

OpenELM共有八个模型:四个预训练模型和四个指令调整模型,涵盖从2.7亿到30亿个不同参数(参数指LLM中人工神经元之间的连接数,通常参数越多表示性能越强、功能越多)。

虽然预训练是让LLM生成连贯且可能有帮助的文本的方法,但它主要是一种预测性练习,而指令调整则是让LLM对用户的特定请求做出更相关输出的方法。

预训练可能导致模型只是用简单的文本来完成提示,例如,面对用户的提示“教我如何烤面包”,模型可能会作出“用家里的烤箱”的类似回应,而不是实际的分步指导。

苹果公司在其所谓的“示例代码许可”下提供了OpenELM模型的权重,以及不同的训练检查点、模型性能统计、预训练、评估、指令调整和参数微调等说明。

“示例代码许可证”并不禁止商业使用或修改,只是规定“如果不加修改地重新发布苹果软件的全部内容,必须在文本中保留本通知”。

苹果公司进一步指出,这些模型“没有任何安全保证”。因此,这些模型在响应用户提示时有可能产生“不准确、有害、有偏见或令人反感的输出结果”。

苹果是一家出了名的神秘和典型的“封闭”科技公司,除了在网上发布这些模型和论文之外,还没有公开宣布过其在这一领域的研究过程。

此外,早在去年的10月份,苹果公司就悄然发布了具有多模态功能的开源语言模型Ferret,成为头条新闻。

OpenELM是开源高效语言模型“Open-source Efficient Language Models”的缩写,虽然刚刚发布,尚未进行公开测试,但苹果公司在HuggingFace上的列表表明,它正将目标锁定在模型的设备应用上,就像竞争对手谷歌、三星和微软一样。

值得注意的是,微软本周刚刚发布了可完全在智能手机上运行的Phi-3 Mini模型。

02.技术细节与训练过程

苹果公司在一篇介绍该模型系列的论文中指出:OpenELM的开发“由Sachin Mehta领导,Mohammad Rastegari和Peter Zatloukal也是主要贡献者”,该模型系列“旨在授权和加强开放研究社区,促进未来的研究工作”。

OpenELM模型共有四种参数规模:2.7亿、4.5亿、11亿和30亿,每种规模都小于许多高性能模型(它们通常有大约70亿个参数),每种模型都有一个预训练和指导版本。

这些模型是在来自Reddit、维基百科、arXiv.org等网站的1.8万亿个token的公共数据集上预先训练的。

这些模型适合在商用笔记本电脑甚至某些智能手机上运行,基准测试则是在“英特尔i9-13900KF CPU、英伟达RTX 4090 GPU、Ubuntu 22.04工作站、macOS 14.4.1的MacBook Pro”上运行的。

有趣的是,新系列中的所有机型都采用了分层缩放策略,在变压器模型的每一层中分配参数。

据苹果公司称,这使它们能够在提高计算效率的同时提供更高的精度结果。同时,苹果使用新的CoreNet库对模型进行了预训练。

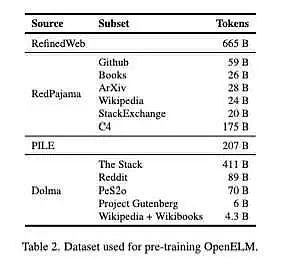

苹果公司在HuggingFace上指出:“我们的预训练数据集包含RefinedWeb、重复的PILE、RedPajama的一个子集和Dolma v1.6的一个子集,总计约1.8万亿个token。”

在性能方面,苹果公司分享的OpenLLM结果表明,这些模型的性能相当不错,尤其是4.5亿个参数的指示变体。

此外,拥有11亿个参数的“OpenELM变体”比拥有12亿个参数的“OLMo”高出2.36%,同时所需的预训练token减少了2倍。

OLMo是Allen人工智能研究所(AI2)最近发布的“真正开源、最先进的大型语言模型”。

03.性能测试与社区反馈

在旨在测试知识和推理能力的ARC-C基准测试中,预训练的OpenELM-3B变体的准确率为42.24%。同时,在MMLU和HellaSwag上,它的准确率分别为26.76%和73.28%。

一位已经开始测试OpenELM模型的用户指出:该模型似乎是一个“可靠的模型,但非常统一”,这意味着它的回复既没有广泛的创造性,也不可能涉足NSFW领域。

竞争对手微软最近推出的Phi-3 Mini,拥有38亿个参数和4k上下文长度,目前在这一领域处于领先地位。

根据最近分享的统计数据,OpenELM在10次ARC-C基准测试中的得分率为84.9%,在5次MMLU测试中的得分率为68.8%,在5次HellaSwag测试中的得分率为76.7%。

从长远来看,OpenELM的性能有望得到提升。

但苹果公司的开源举措已经让社区兴奋不已,我们将拭目以待社区如何在不同环境中使用OpenELM。

04.苹果的人工智能愿景

苹果公司一直对其生成式人工智能计划保持沉默,但随着新人工智能模型的发布,该公司近期的雄心似乎坚定地落在了“让人工智能在苹果设备上本地运行”的领域。

苹果公司首席执行官Tim Cook曾预告说:“人工智能生成功能将出现在苹果设备上”。并在今年2月表示,苹果公司正在该领域花费“大量的时间和精力”。不过,苹果公司尚未透露人工智能应用的具体细节。

该公司之前发布过其他人工智能模型,不过还没有像竞争对手那样发布任何用于商业用途的人工智能基础模型。

除了OpenELM,去年12月,苹果曾推出了机器学习框架MLX,该框架的理想状态是让人工智能模型更容易在苹果硅上运行。此外,还发布了一个名为MGIE的图像编辑模型,让人们通过提示来修复照片。以及一个名为Ferret-UI的模型可用于智能手机导航。

不过,即使苹果发布了这么多模型,据说该公司还是与谷歌和OpenAI进行了联系,希望将它们的模型引入苹果产品。

原文来源于:

1.https://venturebeat.com/ai/apple-releases-openelm-small-open-source-ai-models-designed-to-run-on-device/

2.https://www.theverge.com/2024/4/24/24139266/apple-ai-model-openelm-iphone-laptops-strategy

中文内容由元宇宙之心(MetaverseHub)团队编译,如需转载请联系我们。

来源:金色财经

交易商排行

更多- 监管中EXNESS10-15年 | 英国监管 | 塞浦路斯监管 | 南非监管93.02

- 监管中FXTM 富拓10-15年 |塞浦路斯监管 | 英国监管 | 毛里求斯监管88.21

- 监管中FXBTG10-15年 | 澳大利亚监管 |83.48

- 监管中GoldenGroup高地集团澳大利亚| 5-10年85.87

- 监管中IC Markets10-15年 | 澳大利亚监管 | 塞浦路斯监管91.71

- 监管中CPT Markets Limited5-10年 | 英国监管 | 伯利兹监管91.56

- 监管中AUS Global5-10年 | 塞浦路斯监管 | 澳大利亚监管86.47

- 监管中OneRoyal10-15年 | 澳大利亚监管 | 塞浦路斯监管 | 瓦努阿图监管85.75

- 监管中易信easyMarkets15-20年 |澳大利亚监管 | 塞浦路斯监管85.38

- 监管中FXCC10-15年 | 塞浦路斯监管 | 直通牌照(STP)85.26